Apple's nye tilgængelighedsfunktioner

Apple har annonceret nye funktioner, der kommer til iOS og iPadOS med fokus på at gøre enheder mere tilgængelige for alle, herunder personer med handicap. Et hovedpunkt i den nye funktionsliste er Eye Tracking. Som navnet antyder, gør dette det muligt for en iPhone eller iPad at spore en brugers øjne til input.

Ved at skifte fokus for deres blik, vil brugere være i stand til at navigere gennem og interagere med apps. Ifølge Apple tillader funktionen brugere at efterligne funktioner som at trykke på elementer, rulle og andre gestus "kun med deres øjne". Selv om en lignende funktion har været tilgængelig på andre enheder i et stykke tid, krævede det ekstra hardware og specialiseret software.

Eye Tracking er ikke app-specifik og kræver ikke ekstra hardware. Kompatible enheder opnår dette ved at bruge det frontvendte kamera og "on-device machine learning", ifølge Apple. Selskabet siger, at alle data, der bruges i denne funktion, vil blive gemt på enheden og ikke blive delt. Funktionen kan vise sig utrolig nyttig for mennesker med begrænset mobilitet og give dem en lettere metode til at bruge deres enhed.

Music Haptics får en iPhone til at vibrere i sync med lyd, der afspilles gennem Apple's Music app. Dette giver ifølge Apple "brugere, der er døve eller har nedsat hørelse, en ny måde at opleve musik på iPhone". Mens funktionen i øjeblikket er designet til Apple's Music app, vil selskabet udgive et API for udviklere, så de kan implementere funktionen i deres apps.

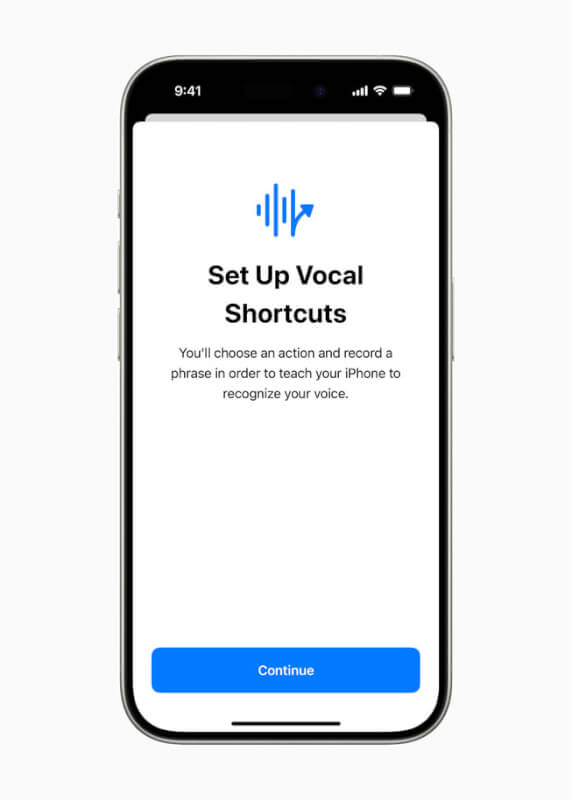

Vocal Genveje tillader brugere at tilpasse vokale kommandoer. Ved hjælp af denne funktion kan Siri forstå non-traditionelle verbale signaler eller lyde for at udføre genveje og andre opgaver. På samme måde tillader "Lyttet efter Atypisk Tale", at enheden lærer, hvordan en bruger taler, hvilket betyder, at personer med påvirket tale kan træne deres telefon til bedre at forstå dem.

Vehicle Motion Cues udfylder enhedens skærm med bevægende prikker for at visuelt signalere brugeren om omgivende bevægelse, f.eks. når man kører i en bil. Funktionen bruger iPhonens eller iPadens sensorer til at animere prikkerne i synkronisering med bevægelse, enten automatisk eller via en knap, der kan placeres i Control Center. CarPlay får også nogle nye tilgængelighedsfunktioner, herunder Voice Control,

Farvefiltre til farveblinde og Lydgenkendelse, der kan hjælpe døve eller hørehæmmede bilister med at genkende miljølyde som sirener eller alarmer. Der er også opdateringer til eksisterende tilgængelighedsfunktioner, som du kan læse om på Apple's nyhedsside.